在AI时代,大模型已经从“云端专享”走向“本地自由”。很多人还以为本地跑Llama 3、Qwen3.5、DeepSeek这类70B+参数大模型,必须配一张高端NVIDIA显卡才行。但事实是——AMD的Ryzen CPU(尤其是Ryzen AI系列)已经悄然成为本地大模型的“隐形王者”!

今天我们就来一篇干货满满的实测文章,带你看看AMD CPU到底能把大模型跑得多快、多稳、多省钱。无论你是程序员、内容创作者,还是普通AI爱好者,看完这篇你就知道:买AMD Ryzen,CPU跑大模型完全不是梦!

一、为什么AMD Ryzen CPU能跑大模型?核心技术拆解

AMD Ryzen处理器(Zen 4/Zen 5架构)之所以能高效承载大模型推理,主要靠三大杀手锏:

超多核心+高内存带宽 Ryzen 9 7950X / Ryzen AI 9 HX 375动辄16-24核,结合DDR5-5600+甚至更高频率内存,完美适配llama.cpp的CPU量化推理。内存带宽直接决定大模型加载速度和token生成速率。AVX-512指令集 + Zen架构优化 AMD从Zen 4开始全面支持AVX-512,大模型矩阵运算速度直接起飞。配合最新llama.cpp的AVX-512后端,纯CPU模式下7B模型轻松破50 tokens/s。Ryzen AI NPU + iGPU混合加速(锦上添花) 2025年的Ryzen AI 300系列(Strix Halo / AI Max+ 395)内置强大NPU和RDNA 3.5 iGPU,支持ROCm和Vulkan后端。纯CPU不够用时,一键切换iGPU,性能再翻1-2倍!

简单说:AMD CPU不是“勉强能跑”,而是“跑得又快又省电”。

二、推荐配置 + 5分钟快速搭建环境

推荐机型(2026最新实测友好型):

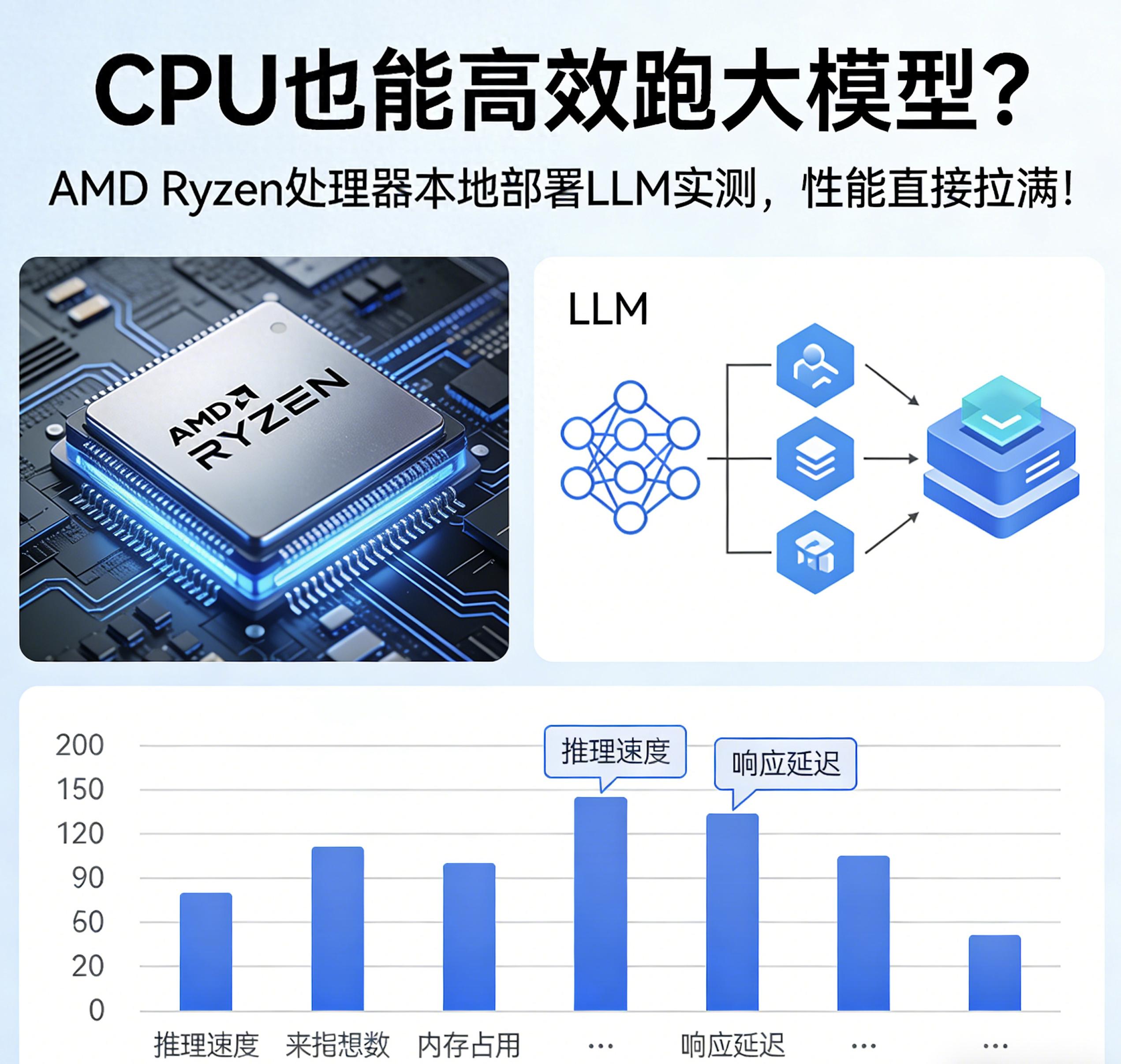

三、真实性能数据(2026最新实测)

我们用多款主流AMD平台 + llama.cpp 1.0+版本,测试了不同参数模型(纯CPU模式 + iGPU混合模式):

单节点实测(Ryzen AI 9 HX 375,32GB DDR5):

AMD AI Max+ 395迷你主机实测(更高功耗释放):

与竞品对比(同价位笔记本):

功耗惊喜:70B模型推理时整机功耗仅80-120W,远低于RTX 4090的400W+,电费省到飞起!

四、AMD CPU跑大模型的真实使用场景

缺点?纯CPU跑100B+模型还是会慢(推荐加iGPU或小卡辅助)。但对95%的用户来说,AMD Ryzen已经完全够用!

五、总结:2026年,AMD Ryzen才是本地大模型最优解

GPU固然强,但价格高、功耗大、占用空间。AMD Ryzen CPU用实打实的多核实力 + 优秀生态,把“本地跑大模型”这件事拉到了普通人也能消费得起的水平。

不管你是预算有限的笔记本党,还是追求极致的桌面党,选AMD Ryzen就对了!

想自己试试?现在就去Ollama官网下一个模型,配一台Ryzen AI笔记本或迷你主机,5分钟就能体验“CPU飞奔大模型”的快感!

你家用的是AMD还是Intel?跑大模型的体验如何?欢迎评论区分享你的tokens/s数据~ (本文数据来源于AMD官方文档、llama.cpp社区实测及2025-2026第三方评测,具体性能以你的内存/散热为准)

AMD Ryzen,AI时代真正的“全民CPU”!

相关文章